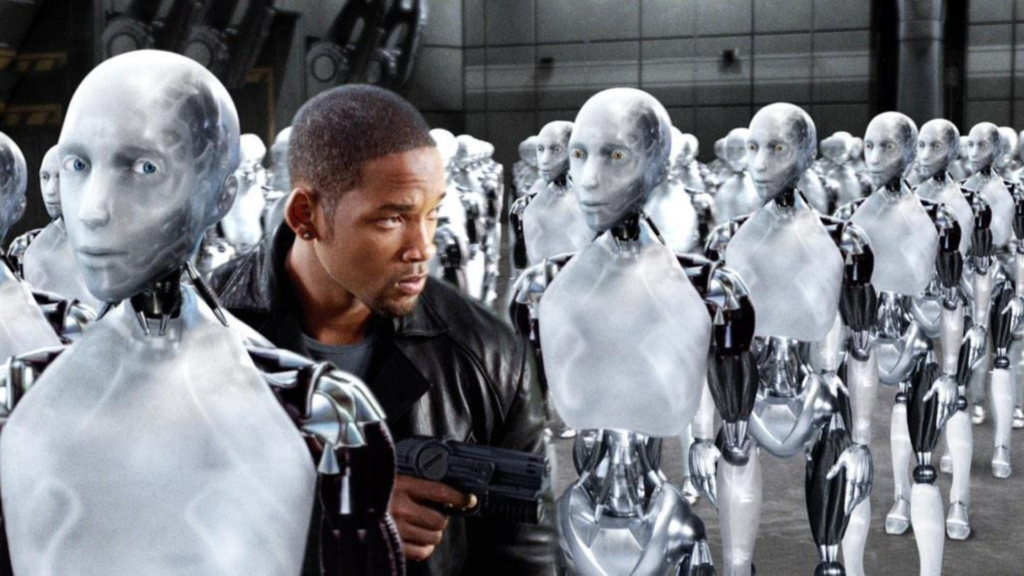

Siamo giunti ad uno scenario distopico come quello che dipingeva il film Io,Robot con Will Smith che ci ha messo in guardia sul pericolo dell’Intelligenza Artificiale. Per ora nessun robot assassino che è pronto a sterminare l’umanità, ma “solo” un allarme dei ricercatori delle Big Tech che ci mettono in guardia sull’uso improprio di questo mezzo.

L’avvertimento arriva dalla pagina web del Center for AI Safety, su cui è stata pubblicata una dichiarazione di alcuni esperti del settore, tra cui Sam Altman, Ad del produttore di ChatGPT OpenAI, Demis Hassabis, amministratore delegato di Google DeepMind e Dario Amodei di Anthropic e sostenuta da Geoffrey Hilton, professore emerito di scienze dei computer nell’Università di Toronto, considerato un pioniere nel settore.

Leggi Anche

L’appello riguarda la necessità di regolamentare il settore dell’Intelligenza artificiale, in modo da renderlo impotente di fronte a scenari plausibilmente pericolosi. “Mitigare il rischio di estinzione causato dall’Intelligenza Artificiale dovrebbe essere una priorità globale insieme ad altri rischi su scala sociale come le pandemie e la guerra nucleare“, queste le parole dei ricercatori che si stanno mobilitando, e stavolta è il caso di dirlo, per salvare l’umanità.

Intelligenza Artificiale: pericoli per il lavoro e la disinformazione

Non siamo di fronte ad una minaccia tangibile o di una super intelligenza pronta a prendere il potere e dominare la nostra specie ma, come spiega il fisico Roberto Battiston che è tra i firmatari dell’appello “dobbiamo contrastare le conseguenze del modo con cui gli esseri umani si abitueranno a utilizzare questi algoritmi nel loro lavoro e nella vita quotidiana della società. Dobbiamo pensare alla possibile interferenza sui processi elettorali, alla diffusione di notizie false, alla creazione di canali di notizie che rispondono a precisi interessi di disinformazione“.

Purtroppo in buona parte ci troviamo già nel mezzo di questo processo. I programmi che utilizzano questo mezzo crescono di giorno in giorno e sono sempre più potenti e funzionali ma “dobbiamo prepararci a gestire queste situazioni, le prime avvisaglie di problemi di questo genere le abbiamo già viste negli anni passati con la vicenda di Cambridge Analytica o con la tattiche di guerriglia dei troll russi sul web“.

L’IA va usata per scopi benefici in campo biomedico e farmacologico

Anche Luca Simoncini, ex docente di Ingegneria dell’Informazione all’Università di Pisa ed ex direttore dell’Istituto di tecnologie dell’informazione del Consiglio Nazionale delle Ricerche si è unito al coro di allarme delle Big Tech, per cercare di porre un rimedio a un fenomeno che potrebbe in poco tempo sfuggire al nostro controllo.

“L’Intelligenza Artificiale è così pervasiva da avere un forte impatto in molti settori della vita sociale (pensiamo solo al rischio di produzione di fake news o al controllo delle auto autonome), come su aspetti economici, finanziari, politici, educativi ed etici“, ha tentato di spiegare l’esperto ponendo l’attenzione sui vari ambiti in cui tale strumento può rivelarsi davvero utile e quelli in cui invece può diventare potenzialmente pericolosa. “E’ evidente che nessuno può opporsi se una tecnologia emergente è usata per scopi benefici, per esempio in campo biomedico o farmacologico” prosegue quindi Simoncini portando in luce i benefici per cui tale mezzo è originariamente nato e che purtroppo durante il suo percorso evolutivo sono passati in secondo piano.

© Riproduzione riservata